Hội nghị AAAI-26 được tổ chức tại Singapore quy tụ những nhóm nghiên cứu xuất sắc nhất về Trí tuệ nhân tạo toàn cầu. FPT Smart Cloud, Tập đoàn FPT, có hai đại diện tham gia thuyết trình với hai đề tài công nghệ mang tính ứng dụng cao.

AAAI Conference on Artificial Intelligence 2026 (AAAI-26) là kỳ hội nghị thường niên lần thứ 40 của Association for the Advancement of Artificial Intelligence – một trong những diễn đàn học thuật uy tín hàng đầu thế giới về Trí tuệ nhân tạo (AI), diễn ra tại Singapore vào đầu năm 2026. Hội nghị quy tụ các nhóm nghiên cứu xuất sắc toàn cầu và áp dụng quy trình phản biện nghiêm ngặt với tỷ lệ chấp nhận thấp. Năm nay, chỉ khoảng 17,5% bài nộp được chấp nhận, và trong số đó, chỉ 3% được lựa chọn để trình bày trực tiếp tại hội nghị.

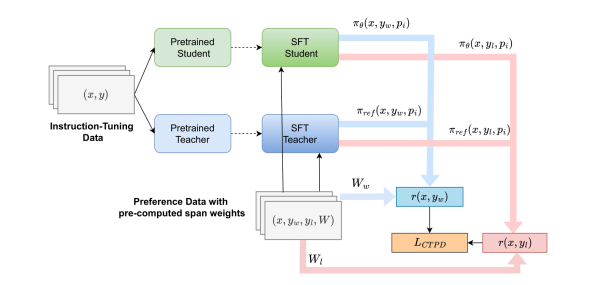

Báo cáo “CTPD: Cross Tokenizer Preference Distillation” (1) – Khi mô hình AI “vừa nhỏ vừa tốt” được kết tinh từ những điểm mạnh của mô hình AI lớn

Nguyễn Thị Ngân (2000) đại diện nhóm tham gia công bố nghiên cứu trực tiếp tại Hội nghị với báo cáo “CTPD: Cross Tokenizer Preference Distillation” (phương pháp “chưng cất” để chuyển cách trả lời theo kỳ vọng con người giữa các mô hình dùng bộ tách từ khác nhau). Nhóm tác giả gồm Truong Nguyen, Phi Van Dat, Ngan Nguyen, Linh Ngo Van, Trung Le và Thanh Hong Nguyen, với mục tiêu chung là tạo ra mô hình “vừa nhỏ vừa tốt” để dễ đưa vào vận hành thực tế.

Trong triển khai AI, các mô hình ngôn ngữ quy mô lớn thường cho chất lượng trả lời tốt nhưng chi phí vận hành cao. Vì vậy, doanh nghiệp hay chọn mô hình gọn hơn để chạy nhanh và tiết kiệm tài nguyên, nhất là với các kênh cần xử lý lượng lớn yêu cầu như chatbot. Vấn đề nằm ở chỗ mô hình gọn thường khó đạt được cách trả lời “đúng kỳ vọng con người” như mô hình mạnh đã được huấn luyện kỹ.

Để giải bài toán này, một hướng phổ biến là “chưng cất” (distillation), tức cho mô hình gọn học lại cách trả lời từ mô hình mạnh. Tuy nhiên, nhóm nghiên cứu chỉ ra một điểm nghẽn khiến nhiều cách làm bị hạn chế đó là: mô hình mạnh và mô hình gọn có thể dùng bộ tách từ (tokenizer) khác nhau, nghĩa là cùng một câu nhưng mỗi mô hình chia nhỏ thành các phần không trùng nhau. Khi “cắt chữ” khác nhau, việc truyền các tín hiệu huấn luyện chi tiết giữa hai mô hình trở nên khó khăn.

Ngân Nguyễn cho biết, CTPD là một cách giúp mô hình gọn học theo đúng kỳ vọng con người từ mô hình mạnh, ngay cả khi hai mô hình dùng bộ tách từ khác nhau. “Nhóm em có cách dạy mô hình nhỏ học ‘cách trả lời hợp ý người dùng’ từ mô hình lớn đã làm tốt sẵn. Điểm hay là dù hai mô hình có cách ‘cắt chữ’ khác nhau, nhóm em vẫn nối được chúng bằng cách căn theo vị trí ký tự trong câu gốc,” Ngân chia sẻ.

Nói đơn giản, thay vì cố ép hai mô hình phải tách câu giống nhau, CTPD bám vào câu gốc và dùng vị trí ký tự làm mốc chung để “căn” hai bên với nhau. Từ đó, mô hình gọn có thể học được cách trả lời theo tiêu chí mà con người lựa chọn, mà không bị kẹt vì khác cách tách từ.

Nhóm cho biết, về nguyên tắc, phương pháp này có thể áp dụng trong hầu hết các lĩnh vực như chăm sóc khách hàng, luật, ngân hàng…, miễn là có dữ liệu theo dạng một câu hỏi kèm hai câu trả lời và biết câu nào được chọn là tốt hơn. “Vì AI học theo tiêu chí từ dữ liệu đó nên dễ mang vào quy trình trả lời chuẩn của từng ngành,” nhóm chia sẻ.

Trong chăm sóc khách hàng, doanh nghiệp có thể dùng dữ liệu về các tình huống phổ biến như giao hàng trễ, đổi trả, hoàn tiền, tra cứu đơn hàng để tạo các cặp trả lời “tốt hơn – kém hơn” theo đúng quy định và giọng điệu thương hiệu. Mô hình gọn sau đó học cách trả lời lịch sự, bám chính sách, và tránh hứa bừa khi thiếu thông tin, trong khi vẫn giữ lợi thế chạy nhanh và tiết kiệm chi phí.

Để kiểm chứng hiệu quả, nhóm tác giả thử nghiệm theo hai kịch bản chuyển giao phổ biến từ mô hình Qwen sang Llama và đánh giá trên các bộ kiểm tra quen thuộc như ARC, HellaSwag, Winogrande, MMLU, TruthfulQA và GSM8k. Nhóm cho biết kết quả cho thấy CTPD cải thiện ổn định so với các phương pháp nền tảng và lợi thế đến từ việc xử lý đúng bài toán “khác bộ tách từ”, vốn rất thường gặp khi doanh nghiệp thay đổi họ mô hình hoặc kết hợp nhiều mô hình trong cùng một hệ thống.

Ngân Nguyễn chia sẻ nghiên cứu được thực hiện trong khoảng 3 tháng. Trước hạn nộp bài một tuần, kết quả thử nghiệm vẫn chưa đạt như mong muốn, khiến cả nhóm chịu áp lực lớn. Tuy nhiên, ba ngày trước hạn nộp bài, kết quả đã cải thiện rõ rệt và đủ tiêu chuẩn để nộp. “Lúc bài được chấp thuận cả nhóm đã rất vui, nhưng bất ngờ và hạnh phúc hơn là khi nhận được email thông báo bài sẽ được trình bày trực tiếp tại hội nghị,” Ngân nói.

Ngân cũng nhấn mạnh tính ứng dụng của nghiên cứu: “Paper này giới thiệu một cách ‘truyền lại’ phong cách trả lời theo kỳ vọng con người từ mô hình mạnh sang mô hình gọn, để mô hình gọn vẫn trả lời tự nhiên và dễ triển khai hơn. Nhóm mình mong cách làm này giúp cộng đồng tái sử dụng các mô hình mạnh sẵn có để tạo ra các mô hình gọn, rẻ và thực dụng cho nhiều bài toán khác nhau.”

Trong tương lai, nhóm nghiên cứu theo hướng phát triển tập trung sâu hơn vào các lĩnh vực cụ thể như y tế và giáo dục, nơi tiêu chí “câu trả lời tốt” thường có chuẩn mực rõ ràng và yêu cầu an toàn cao. Với định hướng tạo ra mô hình gọn nhưng vẫn đáp ứng kỳ vọng người dùng, nhóm kỳ vọng cách tiếp cận này có thể giúp rút ngắn quá trình đưa AI từ nghiên cứu sang vận hành trong môi trường doanh nghiệp.

Download paper: https://arxiv.org/abs/2601.11865

Học nhóm với AI Agents, giúp giải quyết vấn đề theo quy trình

Đại diện nhóm nghiên cứu thứ hai của FPT Smart Cloud tại AAAI-26 là Tiến sĩ Trần Văn Khánh, kỹ sư AI. Nhóm giới thiệu công trình “SAGE: A Compositional Multi-Agent LLM Framework with Pedagogical Reasoning for Structured Collaborative Problem Solving”, tập trung vào một bài toán quen thuộc của giáo dục trực tuyến: học sinh học một mình dễ nản, học nhóm dễ loạn, còn giáo viên rất khó thiết kế một kịch bản học nhóm vừa hiệu quả vừa có cấu trúc sư phạm.

Theo nhóm nghiên cứu, SAGE là một khung “học nhóm với AI”, trong đó thay vì chỉ có một chatbot hỏi gì đáp nấy, hệ thống tạo ra một nhóm “bạn học AI” với vai trò rõ ràng. Nhóm mô phỏng một buổi học nhóm theo hướng gần với đời thực: có một AI Agent đóng vai điều phối để nhắc mục tiêu và tiến độ, một AI Agent đóng vai chuyên gia để hỗ trợ kiến thức và cách giải, và một AI Agent đóng vai động viên để giảm căng thẳng và giữ tinh thần học tập. Nhóm nghiên cứu cho rằng, việc phân vai giúp cân bằng giữa mục tiêu hoàn thành bài và trải nghiệm cảm xúc của người học, thay vì chỉ tối ưu câu trả lời đúng.

Điểm đáng chú ý của SAGE là cơ chế để các AI Agent biết nói đúng lúc và im đúng lúc. Trong nhiều hệ thống cũ, lượt nói của từng Agent thường bị chỉ định cứng nhắc, khiến cuộc thảo luận thiếu tự nhiên và đôi khi làm học sinh phụ thuộc. Với SAGE, các AI Agent có cơ chế tự chủ thay phiên nói: trước khi phản hồi, Agent tự cân nhắc có cần lên tiếng không và nên nói gì để phù hợp với tình huống học tập. Cách tiếp cận này giúp buổi học giống một cuộc trao đổi nhóm hơn, đồng thời hạn chế việc AI trả lời giúp quá sớm.

Về mặt sư phạm, SAGE vận hành theo tư duy giàn giáo (scaffolding) với hai giai đoạn. Ở giai đoạn lập kế hoạch trước (offline), hệ thống tạo ra một kịch bản hướng dẫn có cấu trúc để giảm gánh nặng soạn bài. Khi vào học tương tác (interactive), ban đầu nhóm AI Agent hỗ trợ nhiều để người học không mắc kẹt, sau đó giảm dần gợi ý khi nhận thấy học sinh đã hiểu, nhằm tăng năng lực tự giải quyết vấn đề. Nhóm mô tả đây là cách giúp học sinh chuyển từ trạng thái phụ thuộc sang chủ động, thay vì chỉ nhận đáp án.

Tiến sĩ Trần Văn Khánh chia sẻ: “Nhóm nghiên cứu đã thử nghiệm trên các bài toán chương trình lớp 12 và cho biết SAGE đạt tỷ lệ thắng 72,13% về hiệu quả sư phạm so với một số cách tiếp cận khác trong thiết lập đánh giá của nhóm. Theo quan sát của nhóm, khi AI Agent hỗ trợ đúng nhịp và biết lùi lại đúng lúc, học sinh có xu hướng tự tin hơn, tham gia chủ động hơn và đi theo quy trình giải bài rõ ràng hơn thay vì chuyển thẳng tới đáp án.”

Nhóm cho rằng SAGE phù hợp với các nền tảng giáo dục trực tuyến, các chương trình đào tạo kỹ năng giải quyết vấn đề theo nhóm, và mô phỏng lớp học ảo để luyện kỹ năng làm việc nhóm. Về phía giáo viên và người thiết kế nội dung, lợi ích thực tế là giảm thời gian xây dựng kịch bản học nhóm, vốn thường tốn công và đòi hỏi kinh nghiệm sư phạm. Về phía học sinh, hệ thống giúp rút ngắn thời gian loay hoay không biết bắt đầu từ đâu bằng cách dẫn dắt theo từng bước nhỏ, nhưng vẫn hướng tới mục tiêu cuối cùng là người học tự làm chủ.

Về quá trình phát triển, nhóm là sự kết hợp giữa khối nghiên cứu hàn lâm (Viện Trí tuệ Nhân tạo – ĐH CNTT & TT Thái Nguyên, ĐH Công nghệ – ĐHQGHN) và khối công nghiệp (Viện Nghiên cứu Công nghệ FPT) cùng chung một trăn trở: AI hiện nay có thể rất giỏi trả lời, nhưng áp dụng vào học nhóm vẫn còn thiếu cấu trúc sư phạm và thiếu tính “người” trong tương tác. Nhóm cũng thừa nhận thách thức tiếp theo là chi phí và độ trễ khi triển khai hệ đa tác nhân (Multi-Agent) ở quy mô lớn, đồng thời cần cải thiện bộ nhớ dài hạn để hệ thống nhớ được lịch sử học tập và thói quen của từng học sinh tốt hơn. Một hướng quan trọng khác là đo lường sâu hơn về kết quả học tập thực chất, không chỉ dừng ở mức độ tương tác và quy trình học.

Download paper: https://www.researchgate.net/publication/400077856_SAGE_A_Compositional_Multi-Agent_LLM_Framework_with_Pedagogical_Reasoning_for_Structured_Collaborative_Problem_Solving

Từ tối ưu chi phí triển khai đến nâng chất lượng trải nghiệm học tập, hai công trình cho thấy cách FPT tiếp cận AI theo hướng ứng dụng: giải bài toán cụ thể, có thể đo lường và có thể mở rộng. Đây cũng là nền tảng để các nhóm nghiên cứu tiếp tục phát triển theo các lĩnh vực chuyên sâu hơn trong thời gian tới, đưa những kết quả học thuật từ các hội nghị hàng đầu thế giới thành giá trị thực tiễn cho doanh nghiệp và cộng đồng.