Neural Network là một trong những công nghệ cốt lõi trong lĩnh vực trí tuệ nhân tạo và học máy, mô phỏng cách thức hoạt động của bộ não con người để ra quyết định. Với cấu trúc bao gồm các tầng nơ-ron nhân tạo, Neural Network học từ dữ liệu và có khả năng cải thiện độ chính xác qua thời gian. Trong bài viết này, FPT.AI sẽ chia sẻ chi tiết về cấu tạo, cơ chế hoạt động, các loại mạng nơ-ron cũng như những ứng dụng của công nghệ này trong đời sống hiện đại.

Neural Network là gì?

Neural Network (mạng nơ-ron nhân tạo) là một mô hình học máy được xây dựng dựa trên nguyên lý mô phỏng cách não người truyền và xử lý thông tin. Về bản chất, đây là một mô hình toán học triển khai dưới dạng thuật toán, cho phép máy tính học từ dữ liệu để đưa ra dự đoán hoặc quyết định.

Một Neural Network gồm nhiều lớp nút liên kết với nhau, gồm lớp đầu vào nhận dữ liệu, các lớp ẩn thực hiện xử lý và lớp đầu ra tạo kết quả. Trong quá trình huấn luyện, mô hình tự động điều chỉnh trọng số để giảm sai số và nâng cao độ chính xác. Nhờ cấu trúc này, Neural Network có thể giải quyết các bài toán phức tạp và được ứng dụng rộng rãi trong các lĩnh vực như nhận dạng hình ảnh và xử lý ngôn ngữ tự nhiên như nhận diện giọng nói.

Cấu trúc của Neural Network như thế nào?

Cấu trúc của Neural Network thường gồm 3 lớp cơ bản, mỗi lớp đảm nhận một chức năng riêng trong quá trình xử lý dữ liệu và huấn luyện mô hình, cụ thể:

- Lớp đầu vào – Input Layer: Lớp này tiếp nhận dữ liệu từ môi trường bên ngoài và chuyển chúng vào mạng để bắt đầu quá trình xử lý.

- Lớp ẩn – Hidden Layer: Lớp ẩn nằm giữa lớp đầu vào và lớp đầu ra, có nhiệm vụ xử lý thông tin thông qua các phép tính và hàm kích hoạt để trích xuất đặc trưng từ dữ liệu.

- Lớp đầu ra – Output Layer: Lớp này tổng hợp kết quả từ các lớp trước và tạo ra đầu ra cuối cùng của mô hình, chẳng hạn như dự đoán hoặc phân loại.

Ngoài cấu trúc các lớp, một mạng nơ-ron nhân tạo (Neural Network) còn được hình thành từ những thành phần cốt lõi sau:

- Tế bào nơ-ron – Neurons: Nơ-ron là đơn vị tính toán cơ bản của mạng. Mỗi nơ-ron nhận dữ liệu đầu vào, áp dụng trọng số và độ lệch, sau đó xử lý qua hàm kích hoạt để tạo đầu ra và truyền đến các nơ-ron khác.

- Kết nối – Connections: Các kết nối đóng vai trò truyền tín hiệu giữa các nơ-ron. Mỗi kết nối gắn với một trọng số, thể hiện mức độ ảnh hưởng của tín hiệu đầu vào đến kết quả của nơ-ron nhận.

- Trọng số và độ lệch – Weights and Biases: Trọng số quyết định mức độ tác động của từng đầu vào, còn độ lệch giúp điều chỉnh giá trị đầu ra để mô hình học linh hoạt và chính xác hơn.

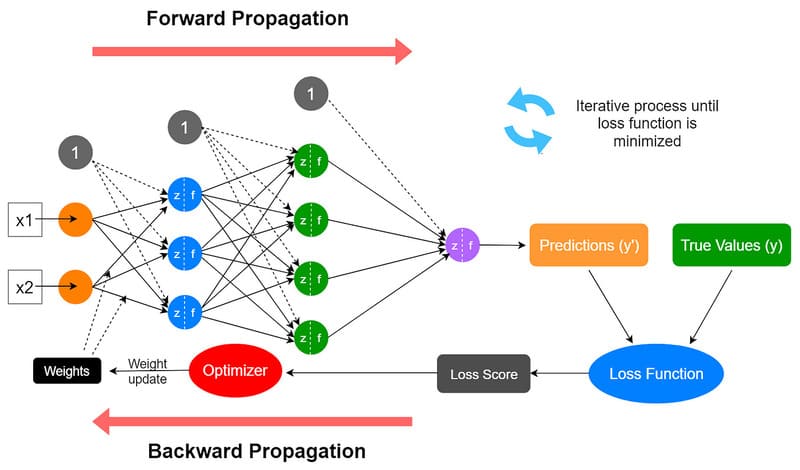

- Lan truyền tiến và lan truyền ngược – Forward & Backward Propagation: Đây là cơ chế cho phép dữ liệu đi qua các lớp để tạo dự đoán và quay ngược lại để cập nhật tham số dựa trên sai số.

- Quy tắc học – Learning Rule: Quy tắc học xác định cách mạng điều chỉnh trọng số và độ lệch trong quá trình huấn luyện nhằm tối ưu hiệu suất và giảm sai số.

Cơ chế hoạt động của mạng nơ-ron nhân tạo ra sao?

Nguyên lý hoạt động của mạng nơ-ron nhân tạo dựa trên 2 cơ chế chính là lan truyền tiến (Forward Propagation) và lan truyền ngược (Backpropagation). Về cơ bản, dữ liệu được xử lý tuần tự qua các lớp để tạo dự đoán, sau đó sai số được truyền ngược lại để điều chỉnh tham số.

Forward Propagation (Lan truyền tiến): Khi dữ liệu được đưa vào mạng, nó sẽ đi từ lớp đầu vào qua các lớp ẩn đến lớp đầu ra. Ở mỗi lớp, mạng nơ-ron thực hiện với 2 bước chính:

- Biến đổi tuyến tính: Mỗi nơ-ron nhận các giá trị đầu vào, nhân chúng với trọng số tương ứng, cộng lại và thêm độ lệch để tạo ra giá trị trung gian. Quá trình này có thể biểu diễn bằng công thức: z = w₁x₁ + w₂x₂ + … + wₙxₙ + b (trong đó w là trọng số, x là đầu vào và b là độ lệch).

- Hàm kích hoạt: Giá trị trung gian sau đó được đưa qua hàm kích hoạt để tạo đầu ra của nơ-ron. Hàm kích hoạt đưa tính phi tuyến vào mô hình, giúp mạng học và biểu diễn các mẫu dữ liệu phức tạp. Các hàm kích hoạt phổ biến gồm ReLU, Sigmoid và Tanh.

Backpropagation (Lan truyền ngược – điều chỉnh trọng số): Sau khi hoàn tất lan truyền tiến, mạng nơ-ron sẽ đánh giá độ chính xác của dự đoán thông qua hàm mất mát (loss function), dùng để đo mức chênh lệch giữa giá trị dự đoán và giá trị thực tế. Mục tiêu của huấn luyện là giảm sai số này xuống mức thấp nhất. Quá trình lan truyền ngược giúp tối ưu mô hình thông qua các bước sau:

- Tính toán hàm mất mát: Mạng tính giá trị hàm mất mát để xác định mức độ sai lệch của dự đoán. Tùy loại bài toán, có thể sử dụng các hàm khác nhau như mean squared error cho hồi quy hoặc cross-entropy cho phân loại.

- Tính toán gradient: Mô hình xác định gradient để biết cần điều chỉnh các tham số theo hướng nào nhằm giảm hàm mất mát. Quá trình này sử dụng quy tắc chuỗi trong vi phân để đo ảnh hưởng của từng trọng số và độ lệch đến sai số đầu ra.

- Cập nhật trọng số: Sau khi có gradient, các tham số được cập nhật bằng thuật toán tối ưu hóa như Stochastic Gradient Descent. Trọng số được điều chỉnh theo hướng ngược với gradient để giảm sai số, với mức điều chỉnh được kiểm soát bởi tham số learning rate (tốc độ học).

Những cơ chế trên được thực hiện lặp lại quá trình (Iteration) như các bước lan truyền tiến, tính hàm mất mát, lan truyền ngược và cập nhật trọng số được lặp lại nhiều lần trên toàn bộ tập dữ liệu huấn luyện. Qua mỗi vòng lặp, giá trị hàm mất mát giảm dần và độ chính xác của dự đoán được cải thiện.

Nhờ cơ chế lặp này, mạng nơ-ron từng bước điều chỉnh các tham số để mô hình hóa tốt hơn mối quan hệ trong dữ liệu. Điều đó giúp nâng cao hiệu suất trong các bài toán như phân loại, hồi quy và nhiều dạng dự đoán khác.

3 phương pháp học của Neural Network

Trong mạng nơ-ron nhân tạo, có ba phương pháp học chính thường được sử dụng để nâng cao khả năng nhận diện và dự đoán.

Supervised Learning – Học có giám sát

Trong phương pháp Supervised Learning, mạng nơ-ron nhân tạo được huấn luyện trên các cặp dữ liệu đầu vào – đầu ra đã có nhãn, tương tự như có một “người hướng dẫn” cung cấp đáp án đúng. Mô hình tiếp nhận dữ liệu đầu vào, xử lý qua nhiều lớp để tạo dự đoán, rồi so sánh kết quả này với giá trị thực tế để tính sai số.

Dựa trên sai số đó, mạng sẽ lặp lại quá trình điều chỉnh các tham số qua nhiều vòng huấn luyện nhằm giảm chênh lệch và cải thiện độ chính xác. Quá trình này tiếp diễn cho đến khi mô hình đạt hiệu suất mong muốn.

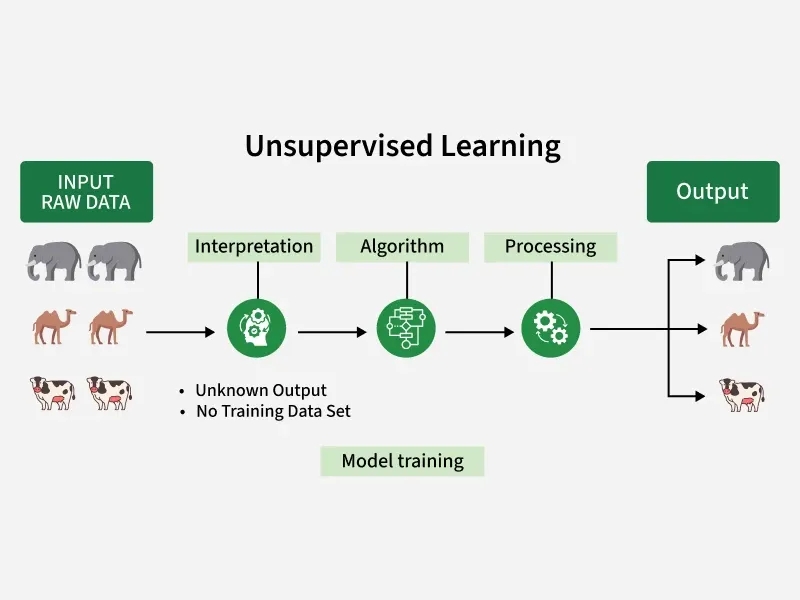

Unsupervised Learning – Học không giám sát

Đây là phương pháp trong đó mạng nơ-ron nhân tạo được huấn luyện trên dữ liệu không có nhãn đầu ra. Mô hình không được cung cấp kết quả mong muốn mà phải tự khám phá cấu trúc và các mẫu tiềm ẩn trong dữ liệu đầu vào.

Để thực hiện điều này, mạng thường áp dụng các kỹ thuật như phân cụm (clustering) và phát hiện mối quan hệ (association) nhằm nhóm các dữ liệu có đặc điểm tương đồng hoặc tìm ra những quy luật chưa được biết đến. Phương pháp học không giám sát được sử dụng phổ biến trong phân tích dữ liệu và khám phá đặc trưng ẩn của tập dữ liệu.

Reinforcement Learning – Học tăng cường

Học tăng cường là phương pháp mà mạng nơ-ron học thông qua quá trình tương tác trực tiếp với môi trường. Mô hình nhận phản hồi dưới dạng phần thưởng hoặc hình phạt dựa trên hành động đã thực hiện, từ đó đánh giá hiệu quả của từng quyết định.

Dựa trên cơ chế phản hồi này, mạng dần xây dựng chiến lược tối ưu nhằm tối đa hóa tổng phần thưởng trong quá trình học. Phương pháp học tăng cường đặc biệt phù hợp với các bài toán yêu cầu ra quyết định liên tục, như trò chơi điện tử, robot tự động và các hệ thống điều khiển phức tạp.

Neural Network có những loại phổ biến nào?

Neural Network có thể được phân thành nhiều loại khác nhau, mỗi loại được thiết kế để giải quyết những bài toán và mục đích sử dụng riêng trong học máy và trí tuệ nhân tạo, gồm các loại phổ biến sau:

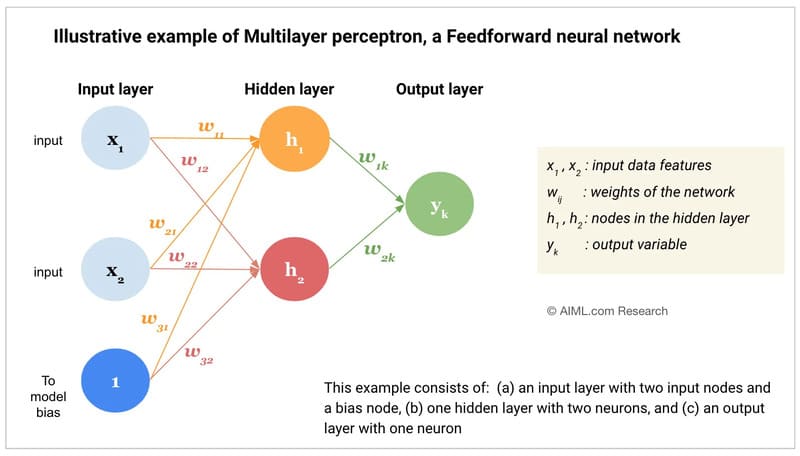

Feedforward Neural Network: Là dạng mạng nơ-ron cơ bản, trong đó dữ liệu chỉ truyền theo một chiều từ lớp đầu vào đến lớp đầu ra mà không có vòng lặp ngược. Kiến trúc này phù hợp với các bài toán đơn giản, khi dữ liệu không có tính chuỗi hoặc không phụ thuộc vào yếu tố thời gian. Feedforward hiện tồn tại các biến thể như:

- Perceptron đơn lớp (Single-layer Perceptron): Mô hình này nhận dữ liệu đầu vào, nhân với trọng số, cộng lại và đưa qua hàm kích hoạt để tạo kết quả. Tuy nhiên, Perceptron đơn lớp chỉ giải quyết được các bài toán phân tách tuyến tính và không xử lý hiệu quả dữ liệu phi tuyến.

- Perceptron đa lớp (Multilayer Perceptron – MLP): Có cấu trúc nhiều lớp, gồm lớp đầu vào, một hoặc nhiều lớp ẩn và lớp đầu ra. Các lớp trong MLP sử dụng hàm kích hoạt phi tuyến để học và biểu diễn các mối quan hệ phức tạp trong dữ liệu. Nhờ kiến trúc này, MLP có thể xử lý các bài toán khó hơn như phân loại và dự đoán, được ứng dụng rộng rãi trong nhiều hệ thống học máy thực tế.

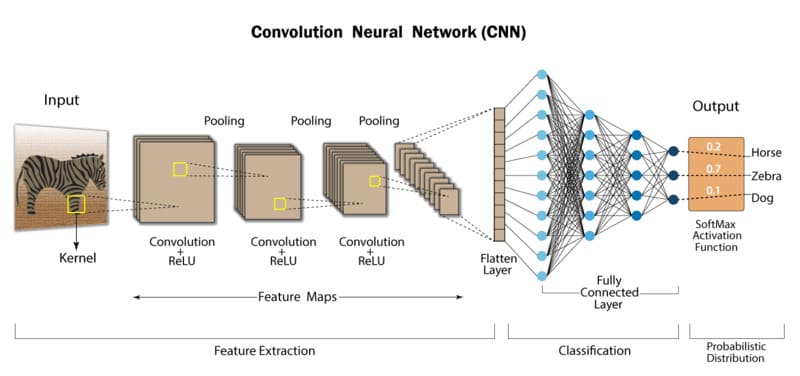

Convolutional Neural Networks (CNN): Mạng nơ-ron tích chập là một kiến trúc mạng chuyên dụng cho việc xử lý dữ liệu dạng lưới như hình ảnh, âm thanh và văn bản. CNN sử dụng các lớp tích chập để tự động trích xuất đặc trưng theo từng cấp độ từ dữ liệu đầu vào. Nhờ cơ chế này, mô hình có thể nhận diện mẫu và phân loại đối tượng trong ảnh một cách hiệu quả. Vì thế, CNN được ứng dụng rộng rãi trong thị giác máy tính (Computer Vision), xử lý ảnh, ngôn ngữ tự nhiên và tín hiệu âm thanh.

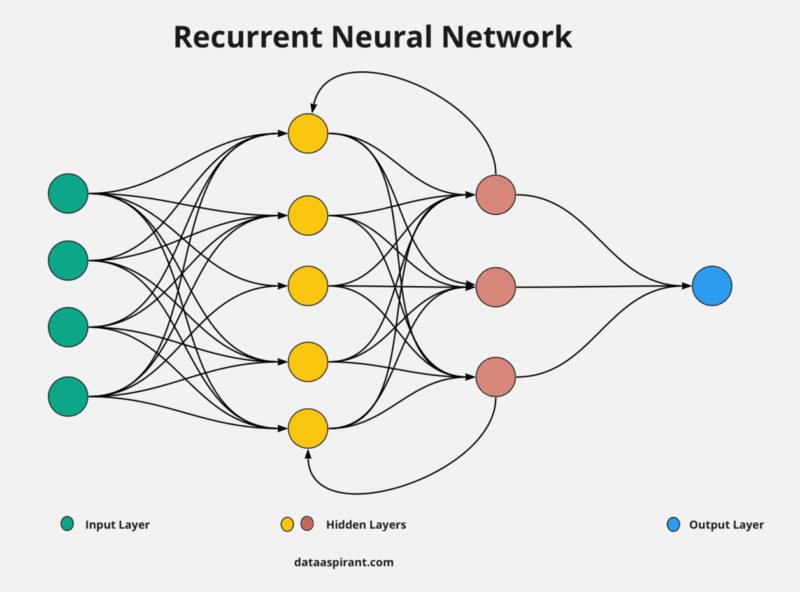

Recurrent Neural Networks (RNN): Là một kiến trúc mạng nơ-ron được thiết kế để xử lý dữ liệu dạng chuỗi, trong đó các phần tử có mối liên hệ theo thời gian hoặc thứ tự. Mạng có khả năng ghi nhớ thông tin từ các bước trước để hỗ trợ việc xử lý dữ liệu ở bước hiện tại. Nhờ đặc điểm này, RNN phù hợp với các bài toán như dự đoán chuỗi thời gian (ví dụ giá cổ phiếu hoặc thời tiết) và xử lý ngôn ngữ tự nhiên, gồm dịch máy và nhận diện giọng nói.

Ngoài ra, RNN còn có biến thể là Long Short-Term Memory (LSTM). LSTM được thiết kế để khắc phục hiện tượng “biến mất gradient” khi huấn luyện trên các chuỗi dữ liệu dài. Mô hình sử dụng các ô nhớ cùng ba cơ chế cổng để kiểm soát việc lưu trữ, cập nhật và loại bỏ thông tin. Từ đó, LSTM cải thiện khả năng ghi nhớ dài hạn và học các phụ thuộc phức tạp trong chuỗi dữ liệu, nên thường được áp dụng trong các bài toán như dịch máy và phân tích ngữ nghĩa văn bản.

Mạng nơ-ron nhân tạo có lợi ích gì?

Hiện nay, mạng nơ-ron nhân tạo được đánh giá cao nhờ khả năng xử lý và phân tích dữ liệu hiệu quả. Một số lợi ích nổi bật, đóng vai trò quan trọng của Neural Network như:

Xử lý song song: Mạng nơ-ron có thể thực hiện nhiều phép tính đồng thời trên các nơ-ron khác nhau. Khả năng xử lý song song này giúp rút ngắn thời gian tính toán và nâng cao hiệu suất khi làm việc với dữ liệu lớn hoặc các bài toán phức tạp.

Tự động trích xuất đặc trưng: Mô hình có khả năng tự học và rút trích các đặc trưng quan trọng trực tiếp từ dữ liệu thô mà không cần thiết kế thủ công. Điều này giúp đơn giản hóa quá trình xây dựng mô hình và tiết kiệm công sức so với các phương pháp học máy truyền thống.

Lưu trữ thông tin phân tán: Thông tin trong mạng nơ-ron được lưu trữ phân tán trên toàn bộ hệ thống thay vì tập trung ở một điểm duy nhất. Nhờ đó, mạng vẫn có thể duy trì hoạt động ổn định ngay cả khi một phần dữ liệu hoặc nơ-ron bị ảnh hưởng.

Khả năng học quan hệ phi tuyến: Mạng nơ-ron có thể mô hình hóa các quan hệ phi tuyến và phức tạp giữa đầu vào và đầu ra. Nhờ đó, mô hình phản ánh chính xác hơn các hiện tượng thực tế mà nhiều phương pháp học máy truyền thống khó xử lý.

Khả năng chịu lỗi: Mạng nơ-ron có tính chịu lỗi cao vì thông tin được phân tán trên toàn hệ thống. Khi một số phần tử gặp sự cố, mạng vẫn có thể tiếp tục hoạt động và duy trì kết quả ở mức chấp nhận được.

Không giới hạn biến đầu vào: Neural Network có thể xử lý nhiều loại dữ liệu đầu vào với đặc điểm khác nhau. Tính linh hoạt này giúp mô hình thích nghi tốt với nhiều bài toán và nguồn dữ liệu đa dạng.

Ra quyết định dựa trên quan sát: Mạng học trực tiếp từ dữ liệu thực tế và đưa ra quyết định dựa trên các mẫu đã quan sát. Điều này hỗ trợ tự động hóa quy trình và nâng cao độ chính xác trong môi trường thay đổi.

Xử lý dữ liệu chưa có cấu trúc: Mô hình có khả năng tổ chức và phân tích dữ liệu lớn, kể cả khi dữ liệu không được cấu trúc rõ ràng. Nhờ vậy, mạng có thể phân loại và nhóm thông tin một cách hiệu quả.

Khả năng phát hiện quan hệ ẩn: Mạng nơ-ron có thể khám phá các mối quan hệ tiềm ẩn trong dữ liệu mà không cần quy tắc lập trình sẵn. Khả năng này giúp mô hình xử lý tốt các tập dữ liệu biến động mạnh và phức tạp.

Khả năng tổng quát hóa: Neural Network không chỉ ghi nhớ dữ liệu huấn luyện mà còn suy luận được trên dữ liệu mới. Nhờ đó, mô hình có thể đưa ra dự đoán cho những tình huống chưa từng xuất hiện trong quá trình huấn luyện.

Mạng nơ-ron nhân tạo tồn tại những hạn chế gì?

Mặc dù mạng nơ-ron nhân tạo mang lại nhiều lợi ích, công nghệ này vẫn tồn tại một số thách thức và hạn chế quan trọng:

Thiếu quy tắc xác định cấu trúc: Không có công thức cố định để chọn kiến trúc mạng tối ưu. Việc thiết kế mô hình thường dựa vào thử nghiệm và kinh nghiệm thực tế.

Tốn nhiều tài nguyên tính toán: Quá trình huấn luyện mạng nơ-ron đòi hỏi năng lực tính toán lớn, có thể gây khó khăn cho các tổ chức có nguồn lực hạn chế.

Phụ thuộc vào phần cứng: Mạng nơ-ron hoạt động hiệu quả hơn trên các hệ thống hỗ trợ xử lý song song như GPU. Vì vậy, việc triển khai thường phụ thuộc vào hạ tầng phần cứng chuyên dụng.

Yêu cầu dữ liệu dạng số: Mô hình chỉ xử lý dữ liệu số, nên dữ liệu đầu vào cần được chuyển đổi và tiền xử lý trước khi huấn luyện.

Nguy cơ cho kết quả kém chính xác: Nếu mô hình được thiết kế hoặc huấn luyện không phù hợp, kết quả dự đoán có thể thiếu chính xác hoặc không ổn định.

Hiện tượng overfitting: Mạng nơ-ron dễ bị overfitting khi huấn luyện với tập dữ liệu nhỏ, làm giảm khả năng tổng quát hóa trên dữ liệu mới.

Ứng dụng Neural Network trong thực tế như thế nào?

Neural Network ngày càng đóng vai trò quan trọng trong nhiều lĩnh vực nhờ khả năng học và xử lý dữ liệu phức tạp. Từ nhận diện hình ảnh, xử lý ngôn ngữ đến dự đoán và tự động hóa, công nghệ này đang được ứng dụng rộng rãi để giải quyết các bài toán thực tế. Dưới đây là những ứng dụng tiêu biểu của Neural Network:

Nhận diện hình ảnh: Các nền tảng như Facebook ứng dụng mạng nơ-ron nhân tạo để tự động nhận diện và gắn thẻ hình ảnh. Thông qua việc huấn luyện trên lượng dữ liệu ảnh lớn, mô hình có thể xác định khuôn mặt và đối tượng với độ chính xác cao. Công nghệ này cũng được triển khai trong hệ thống camera an ninh và nhiều ứng dụng thị giác máy tính khác nhằm nâng cao hiệu quả nhận diện.

Nhận diện giọng nói: Các trợ lý ảo như Siri và Amazon Alexa sử dụng mạng nơ-ron để nhận diện và xử lý giọng nói. Bằng cách học từ tập dữ liệu âm thanh quy mô lớn, mô hình có thể hiểu lệnh của người dùng với nhiều ngôn ngữ và giọng điệu khác nhau. Nhờ đó, hệ thống có thể phản hồi nhanh và chính xác trong thời gian thực.

Chẩn đoán y tế: Mạng nơ-ron nhân tạo đang được ứng dụng rộng rãi trong y tế để hỗ trợ chẩn đoán bệnh thông qua phân tích hình ảnh như X-quang, MRI và CT. Bằng cách phát hiện các dấu hiệu bất thường hoặc tổn thương với độ chính xác cao, mô hình giúp bác sĩ nhận diện bệnh sớm và nâng cao hiệu quả điều trị.

Dự báo tài chính: Trong lĩnh vực tài chính, Neural Network được sử dụng để phân tích dữ liệu quy mô lớn, gồm giá cổ phiếu và các chỉ số kinh tế. Mô hình giúp dự đoán xu hướng thị trường, cung cấp cơ sở dữ liệu quan trọng để nhà đầu tư đưa ra quyết định. Nhờ khả năng học từ dữ liệu lịch sử, mạng nơ-ron còn hỗ trợ tối ưu hóa chiến lược đầu tư và quản lý rủi ro.

Neural Network và Deep Learning có gì khác biệt?

Trong lĩnh vực trí tuệ nhân tạo, Neural Network và Deep Learning là hai khái niệm liên quan chặt chẽ nhưng không hoàn toàn giống nhau. Mặc dù cùng dựa trên nguyên lý chung, mỗi công nghệ có đặc điểm và phạm vi ứng dụng riêng, phù hợp với những bài toán khác nhau trong thực tế.

| TIÊU CHÍ | NEURAL NETWORK | DEEP LEARNING |

| Kiến trúc | Các mạng nơ-ron đơn giản thường được thiết kế với một lớp ẩn. | Các hệ thống học sâu được xây dựng với nhiều lớp ẩn xếp chồng lên nhau. |

| Loại mạng | Feedforward – mạng nơ-ron truyền thẳng. | RNN – mạng nơ-ron quy nạp; CNN – mạng nơ-ron tích chập. |

| Hiệu năng | Hiệu quả với các bài toán đơn giản và các nhiệm vụ phân loại cơ bản. | Xử lý và phân tích dữ liệu quy mô lớn, giải quyết hiệu quả các bài toán phức tạp như xử lý ngôn ngữ tự nhiên và nhận diện giọng nói. |

| Độ phức tạp | Có ít lớp và số lượng tham số nhỏ hơn nên yêu cầu tài nguyên tính toán thấp hơn. | Có nhiều lớp và số lượng tham số lớn nên cấu trúc phức tạp hơn, đòi hỏi tài nguyên tính toán đáng kể. |

| Đào tạo | Thời gian huấn luyện nhanh nhưng khả năng xử lý các bài toán phức tạp còn hạn chế. | Yêu cầu lượng dữ liệu lớn và tài nguyên tính toán đáng kể, nhưng có khả năng xử lý và giải quyết hiệu quả các bài toán phức tạp. |

| Ứng dụng | Phù hợp cho các tác vụ phân loại cơ bản và nhận dạng các mẫu đơn giản trong dữ liệu. | Ứng dụng rộng rãi trong các lĩnh vực như xử lý ngôn ngữ tự nhiên, nhận dạng giọng nói và phân tích dữ liệu phức tạp. |

Xu hướng phát triển của Neural network trong tương lai ra sao?

Neural Network đang phát triển mạnh mẽ và tạo ra những bước tiến quan trọng trong nhiều lĩnh vực, từ xe tự lái đến hệ thống nhận dạng giọng nói. Dựa trên tốc độ đổi mới hiện nay, chúng ta có thể kỳ vọng vào một số xu hướng phát triển nổi bật của công nghệ này trong tương lai.

Cải thiện hiệu suất: So với một thập kỷ trước, mạng nơ-ron nhân tạo đã đạt bước tiến lớn về khả năng xử lý nhờ sự phát triển của thuật toán, kiến trúc và kỹ thuật tối ưu hóa. Những cải tiến này giúp mô hình giải quyết các nhiệm vụ ngày càng phức tạp với độ chính xác cao hơn. Trong tương lai, xu hướng nâng cao hiệu suất của Neural Network được kỳ vọng sẽ tiếp tục tăng tốc.

Dễ giải thích hơn: Một hạn chế quan trọng của Neural Network là khó diễn giải cách mô hình đưa ra quyết định. Tuy nhiên, với sự phát triển của Explainable AI (XAI) và các mô hình lai, khả năng minh bạch hóa quá trình suy luận đang được cải thiện. Điều này giúp tăng mức độ tin cậy và khả năng ứng dụng của mạng nơ-ron trong các lĩnh vực yêu cầu tính giải thích cao.

Kiến trúc lai (Hybrid Architecture): Trong tương lai, các kiến trúc lai kết hợp mạng nơ-ron với những phương pháp học máy khác sẽ trở nên phổ biến. Cách tiếp cận này cho phép tận dụng ưu điểm của nhiều kỹ thuật, từ đó khắc phục hạn chế của từng mô hình riêng lẻ và nâng cao hiệu suất tổng thể của hệ thống.

Học chuyển giao (Transfer Learning): Là kỹ thuật tái sử dụng mô hình đã huấn luyện để giải quyết bài toán mới. Phương pháp này đặc biệt hữu ích khi dữ liệu hạn chế và đã trở thành xu hướng quan trọng trong học sâu. Trong tương lai, Transfer Learning sẽ tiếp tục được mở rộng nhằm rút ngắn thời gian huấn luyện và tăng hiệu quả triển khai Neural Network.

Những câu hỏi thường gặp về Neural network

Neural Networks được phát minh tại thời điểm nào?

Mạng nơ-ron bắt nguồn từ một mô hình toán học mô tả hoạt động của não bộ được đề xuất vào năm 1943. Sau giai đoạn phát triển mạnh trong thập niên 1950 – 1960, lĩnh vực này tạm thời suy giảm sự quan tâm, trước khi được phục hưng vào những năm 1980. Từ đó, mạng nơ-ron dần trở thành công nghệ quan trọng và được ứng dụng rộng rãi trong nghiên cứu trí tuệ nhân tạo vào thập niên 1990.

Huấn luyện Neural Network mất bao lâu?

Thời gian huấn luyện Neural Network phụ thuộc vào kích thước mô hình, lượng dữ liệu và phần cứng sử dụng; có thể kéo dài từ vài phút đến vài ngày hoặc lâu hơn.

Người mới bắt đầu nên học Neural Network từ đâu?

Người mới bắt đầu nên học Neural Network từ kiến thức nền tảng về toán (đại số tuyến tính, xác suất) và lập trình, sau đó tiếp cận các khóa học nhập môn về học máy.

Làm thế nào để cải thiện hiệu suất Neural Network?

Để cải thiện hiệu suất Neural Network, bạn có thể tăng và làm sạch dữ liệu huấn luyện, điều chỉnh siêu tham số (như learning rate, số lớp, batch size), áp dụng kỹ thuật regularization và tối ưu kiến trúc mô hình.

Mạng nơ-ron thần kinh – Neural Network là một công cụ mạnh mẽ trong việc giải quyết các bài toán phức tạp thông qua mô phỏng hoạt động của bộ não con người. Với cấu trúc phân tầng và khả năng học hỏi từ dữ liệu, Neural Network đã chứng minh sự hiệu quả trong nhiều ứng dụng như nhận dạng hình ảnh, nhận diện giọng nói và dự đoán. Trong tương lai, Neural Networks sẽ tiếp tục đóng góp vào sự phát triển của các mô hình Deep Learning, mở ra những tiềm năng không giới hạn trong khoa học máy tính và trí tuệ nhân tạo.

Neural Network là một trong những công nghệ cốt lõi trong lĩnh vực trí tuệ nhân tạo và học máy, mô phỏng cách thức hoạt động của bộ não con người để ra quyết định. Với cấu trúc bao gồm các tầng nơ-ron nhân tạo, Neural Network học từ dữ liệu và có khả năng cải thiện độ chính xác qua thời gian. Trong bài viết này, FPT.AI sẽ chia sẻ chi tiết về cấu tạo, cơ chế hoạt động, các loại mạng nơ-ron cũng như những ứng dụng của công nghệ này trong đời sống hiện đại.

Neural Network là gì?

Neural Network (mạng nơ-ron nhân tạo) là một mô hình học máy được xây dựng dựa trên nguyên lý mô phỏng cách não người truyền và xử lý thông tin. Về bản chất, đây là một mô hình toán học triển khai dưới dạng thuật toán, cho phép máy tính học từ dữ liệu để đưa ra dự đoán hoặc quyết định.

Một Neural Network gồm nhiều lớp nút liên kết với nhau, gồm lớp đầu vào nhận dữ liệu, các lớp ẩn thực hiện xử lý và lớp đầu ra tạo kết quả. Trong quá trình huấn luyện, mô hình tự động điều chỉnh trọng số để giảm sai số và nâng cao độ chính xác. Nhờ cấu trúc này, Neural Network có thể giải quyết các bài toán phức tạp và được ứng dụng rộng rãi trong các lĩnh vực như nhận dạng hình ảnh và xử lý ngôn ngữ tự nhiên như nhận diện giọng nói.

Neural Network mô phỏng cách thức hoạt động của bộ não con người để ra quyết định

Cấu trúc của Neural Network như thế nào?

Cấu trúc của Neural Network thường gồm 3 lớp cơ bản, mỗi lớp đảm nhận một chức năng riêng trong quá trình xử lý dữ liệu và huấn luyện mô hình, cụ thể:

- Lớp đầu vào – Input Layer: Lớp này tiếp nhận dữ liệu từ môi trường bên ngoài và chuyển chúng vào mạng để bắt đầu quá trình xử lý.

- Lớp ẩn – Hidden Layer: Lớp ẩn nằm giữa lớp đầu vào và lớp đầu ra, có nhiệm vụ xử lý thông tin thông qua các phép tính và hàm kích hoạt để trích xuất đặc trưng từ dữ liệu.

- Lớp đầu ra – Output Layer: Lớp này tổng hợp kết quả từ các lớp trước và tạo ra đầu ra cuối cùng của mô hình, chẳng hạn như dự đoán hoặc phân loại.

Ngoài cấu trúc các lớp, một mạng nơ-ron nhân tạo (Neural Network) còn được hình thành từ những thành phần cốt lõi sau:

- Tế bào nơ-ron – Neurons: Nơ-ron là đơn vị tính toán cơ bản của mạng. Mỗi nơ-ron nhận dữ liệu đầu vào, áp dụng trọng số và độ lệch, sau đó xử lý qua hàm kích hoạt để tạo đầu ra và truyền đến các nơ-ron khác.

- Kết nối – Connections: Các kết nối đóng vai trò truyền tín hiệu giữa các nơ-ron. Mỗi kết nối gắn với một trọng số, thể hiện mức độ ảnh hưởng của tín hiệu đầu vào đến kết quả của nơ-ron nhận.

- Trọng số và độ lệch – Weights and Biases: Trọng số quyết định mức độ tác động của từng đầu vào, còn độ lệch giúp điều chỉnh giá trị đầu ra để mô hình học linh hoạt và chính xác hơn.

- Lan truyền tiến và lan truyền ngược – Forward & Backward Propagation: Đây là cơ chế cho phép dữ liệu đi qua các lớp để tạo dự đoán và quay ngược lại để cập nhật tham số dựa trên sai số.

- Quy tắc học – Learning Rule: Quy tắc học xác định cách mạng điều chỉnh trọng số và độ lệch trong quá trình huấn luyện nhằm tối ưu hiệu suất và giảm sai số.

Neural Network được hình thành từ 3 lớp cơ bản và các thành phần cốt lõi

Cơ chế hoạt động của mạng nơ-ron nhân tạo ra sao?

Nguyên lý hoạt động của mạng nơ-ron nhân tạo dựa trên 2 cơ chế chính là lan truyền tiến (Forward Propagation) và lan truyền ngược (Backpropagation). Về cơ bản, dữ liệu được xử lý tuần tự qua các lớp để tạo dự đoán, sau đó sai số được truyền ngược lại để điều chỉnh tham số.

Forward Propagation (Lan truyền tiến): Khi dữ liệu được đưa vào mạng, nó sẽ đi từ lớp đầu vào qua các lớp ẩn đến lớp đầu ra. Ở mỗi lớp, mạng nơ-ron thực hiện với 2 bước chính:

- Biến đổi tuyến tính: Mỗi nơ-ron nhận các giá trị đầu vào, nhân chúng với trọng số tương ứng, cộng lại và thêm độ lệch để tạo ra giá trị trung gian. Quá trình này có thể biểu diễn bằng công thức: z = w₁x₁ + w₂x₂ + … + wₙxₙ + b (trong đó w là trọng số, x là đầu vào và b là độ lệch).

- Hàm kích hoạt: Giá trị trung gian sau đó được đưa qua hàm kích hoạt để tạo đầu ra của nơ-ron. Hàm kích hoạt đưa tính phi tuyến vào mô hình, giúp mạng học và biểu diễn các mẫu dữ liệu phức tạp. Các hàm kích hoạt phổ biến gồm ReLU, Sigmoid và Tanh.

Backpropagation (Lan truyền ngược – điều chỉnh trọng số): Sau khi hoàn tất lan truyền tiến, mạng nơ-ron sẽ đánh giá độ chính xác của dự đoán thông qua hàm mất mát (loss function), dùng để đo mức chênh lệch giữa giá trị dự đoán và giá trị thực tế. Mục tiêu của huấn luyện là giảm sai số này xuống mức thấp nhất. Quá trình lan truyền ngược giúp tối ưu mô hình thông qua các bước sau:

- Tính toán hàm mất mát: Mạng tính giá trị hàm mất mát để xác định mức độ sai lệch của dự đoán. Tùy loại bài toán, có thể sử dụng các hàm khác nhau như mean squared error cho hồi quy hoặc cross-entropy cho phân loại.

- Tính toán gradient: Mô hình xác định gradient để biết cần điều chỉnh các tham số theo hướng nào nhằm giảm hàm mất mát. Quá trình này sử dụng quy tắc chuỗi trong vi phân để đo ảnh hưởng của từng trọng số và độ lệch đến sai số đầu ra.

- Cập nhật trọng số: Sau khi có gradient, các tham số được cập nhật bằng thuật toán tối ưu hóa như Stochastic Gradient Descent. Trọng số được điều chỉnh theo hướng ngược với gradient để giảm sai số, với mức điều chỉnh được kiểm soát bởi tham số learning rate (tốc độ học).

Neural Network hoạt động dựa trên lan truyền tiến và lan truyền ngược

Những cơ chế trên được thực hiện lặp lại quá trình (Iteration) như các bước lan truyền tiến, tính hàm mất mát, lan truyền ngược và cập nhật trọng số được lặp lại nhiều lần trên toàn bộ tập dữ liệu huấn luyện. Qua mỗi vòng lặp, giá trị hàm mất mát giảm dần và độ chính xác của dự đoán được cải thiện.

Nhờ cơ chế lặp này, mạng nơ-ron từng bước điều chỉnh các tham số để mô hình hóa tốt hơn mối quan hệ trong dữ liệu. Điều đó giúp nâng cao hiệu suất trong các bài toán như phân loại, hồi quy và nhiều dạng dự đoán khác.

3 phương pháp học của Neural Network

Trong mạng nơ-ron nhân tạo, có ba phương pháp học chính thường được sử dụng để nâng cao khả năng nhận diện và dự đoán.

Supervised Learning – Học có giám sát

Trong phương pháp Supervised Learning, mạng nơ-ron nhân tạo được huấn luyện trên các cặp dữ liệu đầu vào – đầu ra đã có nhãn, tương tự như có một “người hướng dẫn” cung cấp đáp án đúng. Mô hình tiếp nhận dữ liệu đầu vào, xử lý qua nhiều lớp để tạo dự đoán, rồi so sánh kết quả này với giá trị thực tế để tính sai số.

Dựa trên sai số đó, mạng sẽ lặp lại quá trình điều chỉnh các tham số qua nhiều vòng huấn luyện nhằm giảm chênh lệch và cải thiện độ chính xác. Quá trình này tiếp diễn cho đến khi mô hình đạt hiệu suất mong muốn.

Unsupervised Learning – Học không giám sát

Đây là phương pháp trong đó mạng nơ-ron nhân tạo được huấn luyện trên dữ liệu không có nhãn đầu ra. Mô hình không được cung cấp kết quả mong muốn mà phải tự khám phá cấu trúc và các mẫu tiềm ẩn trong dữ liệu đầu vào.

Để thực hiện điều này, mạng thường áp dụng các kỹ thuật như phân cụm (clustering) và phát hiện mối quan hệ (association) nhằm nhóm các dữ liệu có đặc điểm tương đồng hoặc tìm ra những quy luật chưa được biết đến. Phương pháp học không giám sát được sử dụng phổ biến trong phân tích dữ liệu và khám phá đặc trưng ẩn của tập dữ liệu.

Unsupervised Learning sử dụng phổ biến trong phân tích dữ liệu

Reinforcement Learning – Học tăng cường

Học tăng cường là phương pháp mà mạng nơ-ron học thông qua quá trình tương tác trực tiếp với môi trường. Mô hình nhận phản hồi dưới dạng phần thưởng hoặc hình phạt dựa trên hành động đã thực hiện, từ đó đánh giá hiệu quả của từng quyết định.

Dựa trên cơ chế phản hồi này, mạng dần xây dựng chiến lược tối ưu nhằm tối đa hóa tổng phần thưởng trong quá trình học. Phương pháp học tăng cường đặc biệt phù hợp với các bài toán yêu cầu ra quyết định liên tục, như trò chơi điện tử, robot tự động và các hệ thống điều khiển phức tạp.

Neural Network có những loại phổ biến nào?

Neural Network có thể được phân thành nhiều loại khác nhau, mỗi loại được thiết kế để giải quyết những bài toán và mục đích sử dụng riêng trong học máy và trí tuệ nhân tạo, gồm các loại phổ biến sau:

Feedforward Neural Network: Là dạng mạng nơ-ron cơ bản, trong đó dữ liệu chỉ truyền theo một chiều từ lớp đầu vào đến lớp đầu ra mà không có vòng lặp ngược. Kiến trúc này phù hợp với các bài toán đơn giản, khi dữ liệu không có tính chuỗi hoặc không phụ thuộc vào yếu tố thời gian. Feedforward hiện tồn tại các biến thể như:

- Perceptron đơn lớp (Single-layer Perceptron): Mô hình này nhận dữ liệu đầu vào, nhân với trọng số, cộng lại và đưa qua hàm kích hoạt để tạo kết quả. Tuy nhiên, Perceptron đơn lớp chỉ giải quyết được các bài toán phân tách tuyến tính và không xử lý hiệu quả dữ liệu phi tuyến.

- Perceptron đa lớp (Multilayer Perceptron – MLP): Có cấu trúc nhiều lớp, gồm lớp đầu vào, một hoặc nhiều lớp ẩn và lớp đầu ra. Các lớp trong MLP sử dụng hàm kích hoạt phi tuyến để học và biểu diễn các mối quan hệ phức tạp trong dữ liệu. Nhờ kiến trúc này, MLP có thể xử lý các bài toán khó hơn như phân loại và dự đoán, được ứng dụng rộng rãi trong nhiều hệ thống học máy thực tế.

Feedforward Neural Network hoạt động không có vòng lặp ngược

Convolutional Neural Networks (CNN): Mạng nơ-ron tích chập là một kiến trúc mạng chuyên dụng cho việc xử lý dữ liệu dạng lưới như hình ảnh, âm thanh và văn bản. CNN sử dụng các lớp tích chập để tự động trích xuất đặc trưng theo từng cấp độ từ dữ liệu đầu vào. Nhờ cơ chế này, mô hình có thể nhận diện mẫu và phân loại đối tượng trong ảnh một cách hiệu quả. Vì thế, CNN được ứng dụng rộng rãi trong thị giác máy tính (Computer Vision), xử lý ảnh, ngôn ngữ tự nhiên và tín hiệu âm thanh.

Convolutional Neural Networks (CNN) chuyên xử lý dữ liệu dạng lưới như hình ảnh, âm thanh và văn bản

Recurrent Neural Networks (RNN): Là một kiến trúc mạng nơ-ron được thiết kế để xử lý dữ liệu dạng chuỗi, trong đó các phần tử có mối liên hệ theo thời gian hoặc thứ tự. Mạng có khả năng ghi nhớ thông tin từ các bước trước để hỗ trợ việc xử lý dữ liệu ở bước hiện tại. Nhờ đặc điểm này, RNN phù hợp với các bài toán như dự đoán chuỗi thời gian (ví dụ giá cổ phiếu hoặc thời tiết) và xử lý ngôn ngữ tự nhiên, gồm dịch máy và nhận diện giọng nói.

Ngoài ra, RNN còn có biến thể là Long Short-Term Memory (LSTM). LSTM được thiết kế để khắc phục hiện tượng “biến mất gradient” khi huấn luyện trên các chuỗi dữ liệu dài. Mô hình sử dụng các ô nhớ cùng ba cơ chế cổng để kiểm soát việc lưu trữ, cập nhật và loại bỏ thông tin. Từ đó, LSTM cải thiện khả năng ghi nhớ dài hạn và học các phụ thuộc phức tạp trong chuỗi dữ liệu, nên thường được áp dụng trong các bài toán như dịch máy và phân tích ngữ nghĩa văn bản.

Recurrent Neural Networks (RNN) có khả năng xử lý dữ liệu dạng chuỗi

Mạng nơ-ron nhân tạo có lợi ích gì?

Hiện nay, mạng nơ-ron nhân tạo được đánh giá cao nhờ khả năng xử lý và phân tích dữ liệu hiệu quả. Một số lợi ích nổi bật, đóng vai trò quan trọng của Neural Network như:

Xử lý song song: Mạng nơ-ron có thể thực hiện nhiều phép tính đồng thời trên các nơ-ron khác nhau. Khả năng xử lý song song này giúp rút ngắn thời gian tính toán và nâng cao hiệu suất khi làm việc với dữ liệu lớn hoặc các bài toán phức tạp.

Tự động trích xuất đặc trưng: Mô hình có khả năng tự học và rút trích các đặc trưng quan trọng trực tiếp từ dữ liệu thô mà không cần thiết kế thủ công. Điều này giúp đơn giản hóa quá trình xây dựng mô hình và tiết kiệm công sức so với các phương pháp học máy truyền thống.

Lưu trữ thông tin phân tán: Thông tin trong mạng nơ-ron được lưu trữ phân tán trên toàn bộ hệ thống thay vì tập trung ở một điểm duy nhất. Nhờ đó, mạng vẫn có thể duy trì hoạt động ổn định ngay cả khi một phần dữ liệu hoặc nơ-ron bị ảnh hưởng.

Khả năng học quan hệ phi tuyến: Mạng nơ-ron có thể mô hình hóa các quan hệ phi tuyến và phức tạp giữa đầu vào và đầu ra. Nhờ đó, mô hình phản ánh chính xác hơn các hiện tượng thực tế mà nhiều phương pháp học máy truyền thống khó xử lý.

Khả năng chịu lỗi: Mạng nơ-ron có tính chịu lỗi cao vì thông tin được phân tán trên toàn hệ thống. Khi một số phần tử gặp sự cố, mạng vẫn có thể tiếp tục hoạt động và duy trì kết quả ở mức chấp nhận được.

Mạng nơ-ron nhân tạo có tính chịu lỗi cao

Không giới hạn biến đầu vào: Neural Network có thể xử lý nhiều loại dữ liệu đầu vào với đặc điểm khác nhau. Tính linh hoạt này giúp mô hình thích nghi tốt với nhiều bài toán và nguồn dữ liệu đa dạng.

Ra quyết định dựa trên quan sát: Mạng học trực tiếp từ dữ liệu thực tế và đưa ra quyết định dựa trên các mẫu đã quan sát. Điều này hỗ trợ tự động hóa quy trình và nâng cao độ chính xác trong môi trường thay đổi.

Xử lý dữ liệu chưa có cấu trúc: Mô hình có khả năng tổ chức và phân tích dữ liệu lớn, kể cả khi dữ liệu không được cấu trúc rõ ràng. Nhờ vậy, mạng có thể phân loại và nhóm thông tin một cách hiệu quả.

Khả năng phát hiện quan hệ ẩn: Mạng nơ-ron có thể khám phá các mối quan hệ tiềm ẩn trong dữ liệu mà không cần quy tắc lập trình sẵn. Khả năng này giúp mô hình xử lý tốt các tập dữ liệu biến động mạnh và phức tạp.

Khả năng tổng quát hóa: Neural Network không chỉ ghi nhớ dữ liệu huấn luyện mà còn suy luận được trên dữ liệu mới. Nhờ đó, mô hình có thể đưa ra dự đoán cho những tình huống chưa từng xuất hiện trong quá trình huấn luyện.

Mạng nơ-ron nhân tạo tồn tại những hạn chế gì?

Mặc dù mạng nơ-ron nhân tạo mang lại nhiều lợi ích, công nghệ này vẫn tồn tại một số thách thức và hạn chế quan trọng:

Thiếu quy tắc xác định cấu trúc: Không có công thức cố định để chọn kiến trúc mạng tối ưu. Việc thiết kế mô hình thường dựa vào thử nghiệm và kinh nghiệm thực tế.

Tốn nhiều tài nguyên tính toán: Quá trình huấn luyện mạng nơ-ron đòi hỏi năng lực tính toán lớn, có thể gây khó khăn cho các tổ chức có nguồn lực hạn chế.

Phụ thuộc vào phần cứng: Mạng nơ-ron hoạt động hiệu quả hơn trên các hệ thống hỗ trợ xử lý song song như GPU. Vì vậy, việc triển khai thường phụ thuộc vào hạ tầng phần cứng chuyên dụng.

Yêu cầu dữ liệu dạng số: Mô hình chỉ xử lý dữ liệu số, nên dữ liệu đầu vào cần được chuyển đổi và tiền xử lý trước khi huấn luyện.

Nguy cơ cho kết quả kém chính xác: Nếu mô hình được thiết kế hoặc huấn luyện không phù hợp, kết quả dự đoán có thể thiếu chính xác hoặc không ổn định.

Hiện tượng overfitting: Mạng nơ-ron dễ bị overfitting khi huấn luyện với tập dữ liệu nhỏ, làm giảm khả năng tổng quát hóa trên dữ liệu mới.

Neural Network yêu cầu dữ liệu dạng số nên dữ liệu đầu vào cần được xử lý trước khi huấn luyện

Ứng dụng Neural Network trong thực tế như thế nào?

Neural Network ngày càng đóng vai trò quan trọng trong nhiều lĩnh vực nhờ khả năng học và xử lý dữ liệu phức tạp. Từ nhận diện hình ảnh, xử lý ngôn ngữ đến dự đoán và tự động hóa, công nghệ này đang được ứng dụng rộng rãi để giải quyết các bài toán thực tế. Dưới đây là những ứng dụng tiêu biểu của Neural Network:

Nhận diện hình ảnh: Các nền tảng như Facebook ứng dụng mạng nơ-ron nhân tạo để tự động nhận diện và gắn thẻ hình ảnh. Thông qua việc huấn luyện trên lượng dữ liệu ảnh lớn, mô hình có thể xác định khuôn mặt và đối tượng với độ chính xác cao. Công nghệ này cũng được triển khai trong hệ thống camera an ninh và nhiều ứng dụng thị giác máy tính khác nhằm nâng cao hiệu quả nhận diện.

Nhận diện giọng nói: Các trợ lý ảo như Siri và Amazon Alexa sử dụng mạng nơ-ron để nhận diện và xử lý giọng nói. Bằng cách học từ tập dữ liệu âm thanh quy mô lớn, mô hình có thể hiểu lệnh của người dùng với nhiều ngôn ngữ và giọng điệu khác nhau. Nhờ đó, hệ thống có thể phản hồi nhanh và chính xác trong thời gian thực.

Chẩn đoán y tế: Mạng nơ-ron nhân tạo đang được ứng dụng rộng rãi trong y tế để hỗ trợ chẩn đoán bệnh thông qua phân tích hình ảnh như X-quang, MRI và CT. Bằng cách phát hiện các dấu hiệu bất thường hoặc tổn thương với độ chính xác cao, mô hình giúp bác sĩ nhận diện bệnh sớm và nâng cao hiệu quả điều trị.

Dự báo tài chính: Trong lĩnh vực tài chính, Neural Network được sử dụng để phân tích dữ liệu quy mô lớn, gồm giá cổ phiếu và các chỉ số kinh tế. Mô hình giúp dự đoán xu hướng thị trường, cung cấp cơ sở dữ liệu quan trọng để nhà đầu tư đưa ra quyết định. Nhờ khả năng học từ dữ liệu lịch sử, mạng nơ-ron còn hỗ trợ tối ưu hóa chiến lược đầu tư và quản lý rủi ro.

Neural Network được ứng dụng phổ biến trong ứng dụng giọng nói

Neural Network và Deep Learning có gì khác biệt?

Trong lĩnh vực trí tuệ nhân tạo, Neural Network và Deep Learning là hai khái niệm liên quan chặt chẽ nhưng không hoàn toàn giống nhau. Mặc dù cùng dựa trên nguyên lý chung, mỗi công nghệ có đặc điểm và phạm vi ứng dụng riêng, phù hợp với những bài toán khác nhau trong thực tế.

| TIÊU CHÍ | NEURAL NETWORK | DEEP LEARNING |

| Kiến trúc | Các mạng nơ-ron đơn giản thường được thiết kế với một lớp ẩn. | Các hệ thống học sâu được xây dựng với nhiều lớp ẩn xếp chồng lên nhau. |

| Loại mạng | Feedforward – mạng nơ-ron truyền thẳng. | RNN – mạng nơ-ron quy nạp; CNN – mạng nơ-ron tích chập. |

| Hiệu năng | Hiệu quả với các bài toán đơn giản và các nhiệm vụ phân loại cơ bản. | Xử lý và phân tích dữ liệu quy mô lớn, giải quyết hiệu quả các bài toán phức tạp như xử lý ngôn ngữ tự nhiên và nhận diện giọng nói. |

| Độ phức tạp | Có ít lớp và số lượng tham số nhỏ hơn nên yêu cầu tài nguyên tính toán thấp hơn. | Có nhiều lớp và số lượng tham số lớn nên cấu trúc phức tạp hơn, đòi hỏi tài nguyên tính toán đáng kể. |

| Đào tạo | Thời gian huấn luyện nhanh nhưng khả năng xử lý các bài toán phức tạp còn hạn chế. | Yêu cầu lượng dữ liệu lớn và tài nguyên tính toán đáng kể, nhưng có khả năng xử lý và giải quyết hiệu quả các bài toán phức tạp. |

| Ứng dụng | Phù hợp cho các tác vụ phân loại cơ bản và nhận dạng các mẫu đơn giản trong dữ liệu. | Ứng dụng rộng rãi trong các lĩnh vực như xử lý ngôn ngữ tự nhiên, nhận dạng giọng nói và phân tích dữ liệu phức tạp. |

Xu hướng phát triển của Neural network trong tương lai ra sao?

Neural Network đang phát triển mạnh mẽ và tạo ra những bước tiến quan trọng trong nhiều lĩnh vực, từ xe tự lái đến hệ thống nhận dạng giọng nói. Dựa trên tốc độ đổi mới hiện nay, chúng ta có thể kỳ vọng vào một số xu hướng phát triển nổi bật của công nghệ này trong tương lai.

Cải thiện hiệu suất: So với một thập kỷ trước, mạng nơ-ron nhân tạo đã đạt bước tiến lớn về khả năng xử lý nhờ sự phát triển của thuật toán, kiến trúc và kỹ thuật tối ưu hóa. Những cải tiến này giúp mô hình giải quyết các nhiệm vụ ngày càng phức tạp với độ chính xác cao hơn. Trong tương lai, xu hướng nâng cao hiệu suất của Neural Network được kỳ vọng sẽ tiếp tục tăng tốc.

Dễ giải thích hơn: Một hạn chế quan trọng của Neural Network là khó diễn giải cách mô hình đưa ra quyết định. Tuy nhiên, với sự phát triển của Explainable AI (XAI) và các mô hình lai, khả năng minh bạch hóa quá trình suy luận đang được cải thiện. Điều này giúp tăng mức độ tin cậy và khả năng ứng dụng của mạng nơ-ron trong các lĩnh vực yêu cầu tính giải thích cao.

Explainable AI (XAI) giúp Neural Network minh bạch hơn, tăng độ tin cậy khi ra quyết định

Kiến trúc lai (Hybrid Architecture): Trong tương lai, các kiến trúc lai kết hợp mạng nơ-ron với những phương pháp học máy khác sẽ trở nên phổ biến. Cách tiếp cận này cho phép tận dụng ưu điểm của nhiều kỹ thuật, từ đó khắc phục hạn chế của từng mô hình riêng lẻ và nâng cao hiệu suất tổng thể của hệ thống.

Học chuyển giao (Transfer Learning): Là kỹ thuật tái sử dụng mô hình đã huấn luyện để giải quyết bài toán mới. Phương pháp này đặc biệt hữu ích khi dữ liệu hạn chế và đã trở thành xu hướng quan trọng trong học sâu. Trong tương lai, Transfer Learning sẽ tiếp tục được mở rộng nhằm rút ngắn thời gian huấn luyện và tăng hiệu quả triển khai Neural Network.

Những câu hỏi thường gặp về Neural network

Neural Networks được phát minh tại thời điểm nào?

Mạng nơ-ron bắt nguồn từ một mô hình toán học mô tả hoạt động của não bộ được đề xuất vào năm 1943. Sau giai đoạn phát triển mạnh trong thập niên 1950 – 1960, lĩnh vực này tạm thời suy giảm sự quan tâm, trước khi được phục hưng vào những năm 1980. Từ đó, mạng nơ-ron dần trở thành công nghệ quan trọng và được ứng dụng rộng rãi trong nghiên cứu trí tuệ nhân tạo vào thập niên 1990.

Huấn luyện Neural Network mất bao lâu?

Thời gian huấn luyện Neural Network phụ thuộc vào kích thước mô hình, lượng dữ liệu và phần cứng sử dụng; có thể kéo dài từ vài phút đến vài ngày hoặc lâu hơn.

Người mới bắt đầu nên học Neural Network từ đâu?

Người mới bắt đầu nên học Neural Network từ kiến thức nền tảng về toán (đại số tuyến tính, xác suất) và lập trình, sau đó tiếp cận các khóa học nhập môn về học máy.

Làm thế nào để cải thiện hiệu suất Neural Network?

Để cải thiện hiệu suất Neural Network, bạn có thể tăng và làm sạch dữ liệu huấn luyện, điều chỉnh siêu tham số (như learning rate, số lớp, batch size), áp dụng kỹ thuật regularization và tối ưu kiến trúc mô hình.

Mạng nơ-ron thần kinh – Neural Network là một công cụ mạnh mẽ trong việc giải quyết các bài toán phức tạp thông qua mô phỏng hoạt động của bộ não con người. Với cấu trúc phân tầng và khả năng học hỏi từ dữ liệu, Neural Network đã chứng minh sự hiệu quả trong nhiều ứng dụng như nhận dạng hình ảnh, nhận diện giọng nói và dự đoán. Trong tương lai, Neural Networks sẽ tiếp tục đóng góp vào sự phát triển của các mô hình Deep Learning, mở ra những tiềm năng không giới hạn trong khoa học máy tính và trí tuệ nhân tạo.

Có thể bạn quan tâm: